Новая модель ИИ при поддержке Apple способна генерировать звук и речь из беззвучных видео

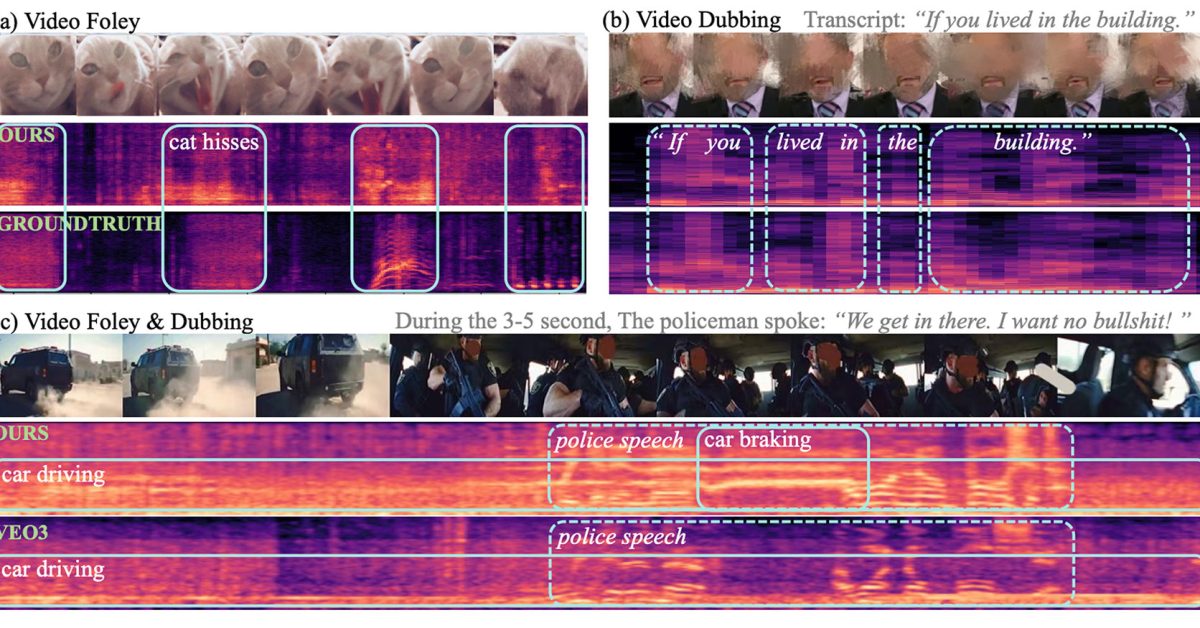

Новая модель под названием VSSFlow использует оригинальную архитектуру для генерации звуков и речи в рамках единой системы, демонстрируя результаты высочайшего уровня. Примеры работы можно оценить в демонстрационных роликах ниже. В настоящее время большинство моделей, преобразующих видео в звук, недостаточно хорошо справляются с генерацией речи. Аналогично, большинство систем преобразования текста в речь не способны создавать неречевые звуки, поскольку изначально разработаны для других целей. Кроме того, предыдущие попытки объединить обе задачи часто исходили из предположения, что совместное обучение ухудшает качество. Это приводило к созданию многоэтапных систем, где речь и звуки обучались раздельно, что усложняло весь процесс. В этой связи три исследователя из Apple и шесть учёных из Китайского народного университета разработали VSSFlow — новую ИИ-модель, способную генерировать, как звуковые эффекты, так и речь из немого видео в рамках единой системы. Более того, созданная ими архитектура устроена так, что обучение речи улучшает обучение генерации звуков, и наоборот, вместо того чтобы мешать друг другу. Если кратко, VSSFlow использует несколько концепций генеративного ИИ, включая преобразование текстовых транскриптов в последовательности фонемных токенов, а также восстановление звука из шума с помощью flow-matching (метода сопоставления потоков). Последний, как мы уже рассказывали, по сути обучает модель эффективно преобразовывать случайный шум в целевой аудиосигнал. Вся эта логика реализована в 10-слойной архитектуре, которая напрямую интегрирует видео- и текстовые данные в процесс генерации аудио, позволяя модели работать, как со звуковыми эффектами, так и с речью в единой системе. Что особенно , исследователи отмечают, что совместное обучение на речевых и звуковых данных фактически улучшило результаты в обеих задачах, а не привело к конкуренции между ними или снижению общей эффективности.